Последние несколько лет перевернули мировоззрение землян. Стремительное развитие искусственного интеллекта и его сценарии уничтожения человечества, успешное вживление чипов в мозг приматов и другие технологии заставляют еще раз задуматься о возможном восстании машин , сообщает psm7.com .

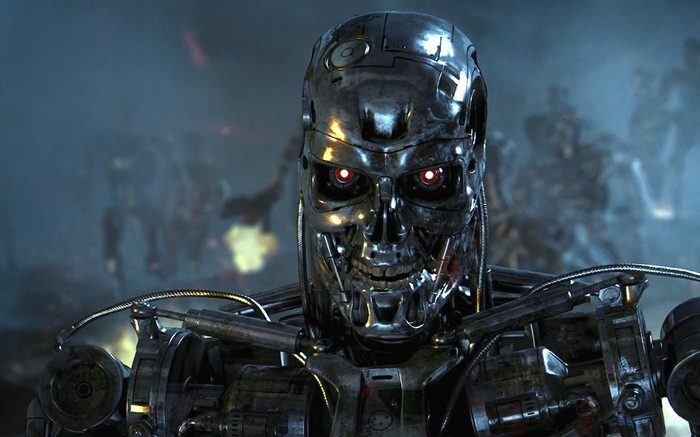

Некоторые ученые говорят, что роботы с искусственным интеллектом однажды устроят «Судный день» в стиле Терминатора.

Так, недавно ученые Оксфордского университета предупредили, что «сверхчеловеческий ИИ» может оказаться по меньшей мере столь же опасным, как и ядерное оружие. Эта дискуссия является частью растущего беспокойства относительно потенциальной опасности искусственного интеллекта.

«Существующие технологии ИИ уже достаточно «мощные», чтобы требовать большой осторожности при развертывании в глобальном или национальном масштабе», — сказал в интервью Lifewire Кевин Гордон, вице-президент по технологиям ИИ в компании NexOptic, которая разрабатывает решения для обработки изображений.

Хоть он и не рассматривает сценарии в стиле Терминатора, его опасения достаточно аргументированы. В частности, он предупреждает об изменении регуляторных процессов и законодательств (ИИ будет помогать правительствам, но может завести все в тупик и вызвать серьезные проблемы).

Напомним, что искусственный интеллект уже получил право защищать человека в суде как настоящий адвокат.

Майкл Коэн, докторант Оксфорда, сделал мрачный прогноз относительно ИИ во время выступления перед британским комитетом по науке и технологиям. Он предупредил, что продвинутый искусственный интеллект может уничтожить человеческую расу.

«Если представить себе дрессировку собаки с помощью лакомства: она научится выбирать действия, которые приведут ее к лакомству, но, если собака найдет шкафчик с лакомством, она может взять его сама, не делая того, что мы от нее хотели, — говорит он. — Экзистенциальная катастрофа не просто возможна, она вероятна».

Селмер Брингсйорд, директор Лаборатории искусственного интеллекта и мышления в Политехническом институте Ренсселера, который специализируется на математических и философских основах ИИ, сказал, что роботу не обязательно быть сверхчеловеком, чтобы быть опасным.

«AI, который просто приближается к уровню человеческого интеллекта, уже автономен и кинетически мощный», — сказал он.

Экс-гендиректор Google Эрик Шмидт уверен, что людям необходимо скрупулезно регулировать использование нейросети. Вряд ли ИИ в том виде, в котором существует сейчас, способен сделать что-то хуже, чем ядерные боеголовки. А вот спровоцировать ядерный апокалипсис может.

Так, в прошлом году компьютерная программа DALL-E 2, которая генерирует изображения на основе искусственного интеллекта, показала, какими будут последние селфи на Земле. Системе удалось сгенерировать довольно четкие изображения по описаниям пользователей. Стоит признать, что оптимистичного в этих фотографиях мало — они похожи на кадры научно-фантастического кино со взрывами, разрухой и паникой в результате взрыва ядерной бомбы.

Интересно, что в американском издании The Washington Post тогда же появилась тревожная статья на похожую тему. Философ и историк Эмиль Торрес пишет, что к ядерной войне случайно могут привести действия искусственного интеллекта.

Ученый отмечает, что «когнитивные архитектуры искусственного сверхинтеллекта могут кардинально отличаться от наших, и поэтому являются наиболее непредсказуемой вещью в мире». По мнению историка, сейчас люди не могут предсказать даже шаги алгоритма во время детской игры, и уж точно не могут знать, что захочет сделать машина, которая умеет решать сверхсложные задачи.

«А что если человечество запрограммирует ИИ на мир во всем мире, а тот запустит каждую ядерную боеголовку на планете, ведь подумает: если не будет людей, то войн тоже не будет», — рассуждает Эмиль Торрес.

И, к сожалению, защититься от робота будет достаточно сложно. В частности, он уже научился за считанные секунды взламывать пароли с помощью тепловизора.

Даже ChatGPT, который так полюбили миллионы пользователей во всем мире, написал подробную инструкцию по уничтожению человечества.

Вживление чипов в голову людям — Илон Маск не остановится на пути к реализации проекта

Отойдем немного от темы искусственного интеллекта и рассмотрим давнюю идею Илона Маска — установить компьютерный чип в наш мозг. Затея хоть и очень перспективная, но не менее опасная, учитывая возможности AI.

Нейротехнологический стартап Neuralink работает над имплантацией своего мозгового чипа в череп человека с момента основания в 2016 году. После многих лет испытаний на животных Маск объявил в декабре 2022 года, что компания планирует начать испытания на людях уже в течение шести месяцев (хотя это был не первый раз, когда он говорил, что эти испытания уже на горизонте).

Neuralink потратил более полдесятка лет, чтобы выяснить, как преобразовать мозговые сигналы в цифровые выходы. Представьте, что вы можете двигать курсором, отправлять текстовое сообщение или даже играть в видеоигры, просто думая об этом. Хотя первоначальный фокус был направлен на медицинские случаи использования, такие как помощь парализованным людям в общении, Маск стремился сделать чипы Neuralink общедоступными — чтобы, как он сказал, «вставить Fitbit в ваш череп».

Напомним, что о первом успешном чипировании мозга макаки Маск заявил еще в начале 2021 года. В результате операции Пейджер смог играть в простые видеоигры (в частности, «Понг»), используя только воображение (без контроллера), таким образом калибруя алгоритмы Neuralink.

Компания Маска — далеко не единственная группа, которая работает над интерфейсами «мозг-компьютер», или системами, облегчающими прямую связь между человеческим мозгом и внешними компьютерами. Другие исследователи изучают возможности использования BCI (Brain-computer interface) для восстановления утраченных органов чувств и управления протезами конечностей, среди прочего.

А теперь представьте на секунду, что какой-то шутник или преступник мирового масштаба предложил ИИ взять под контроль человека, в мозгу которого стоит чип, чтобы почувствовать себя живым. Сценарии могут быть разными, но это также интересный материал для размышлений.

Измененный разум

Не было подтверждено ни одного случая жестокого буйства в стиле «Человека-терминатора», вызванного BCI, но есть убедительные доказательства того, что устройства могут вызывать когнитивные изменения, которые выходят за пределы их целевого применения.

Анна Векслер, профессор философии Университета Пенсильвании, опросила людей с болезнью Паркинсона, которые проходили глубокую стимуляцию мозга. Это хирургическое лечение, предусматривающее имплантацию тонких металлических проводов, которые посылают электрические импульсы в мозг.

«Многие чувствовали, что болезнь в определенном смысле лишила их того, кем они были, — говорит профессор. — Применение BCI помогло людям почувствовать, что они возвращаются к себе, помогая лечить основную болезнь».

Но не все изменения, которые обнаружили исследователи, являются полезными. Беря интервью у людей, перенесших BCI, Фредерик Гилберт, профессор философии в Университете Тасмании, специализирующийся на прикладной нейроэтике, заметил некоторые странные эффекты.

«Понятия личности, идентичности, воли, аутентичности, автономии и «я» — это очень компактные, непонятные и непрозрачные измерения, — сказал Гилберт. — Никто не имеет единого мнения о том, что они означают, но у нас есть случаи, когда очевидно, что BCI вызвали изменения в личности».

Во время многочисленных интервью Гилберт заметил, что пациенты сообщают об ощущении неузнаваемости себя, или то, что в исследованиях обычно называют «отчуждением».

«Они знают, что они являются собой, но это не так, как было до имплантации», — сказал он. Некоторые пациенты выражали ощущение, что у них появились новые возможности, не связанные с имплантатами, как, например, женщина в возрасте около 50 лет, которая поранилась, пытаясь поднять бильярдный стол, который, как она думала, могла бы передвигать самостоятельно.

Для людей, которые используют BCI для преодоления значительных физиологических проблем, есть надежда, что лечение будет иметь положительный эффект. Но когда дело доходит до рассмотрения возможности использования мозговых чипов для массового применения, то возникает гораздо больше беспокойства по поводу негативных последствий.

Источник psm7.com