Сейчас многие используют для работы языковые модели на основе нейронных сетей, такие как ChatGPT. Но не многие задумываются о том, насколько безопасно доверять этой технологии персональные данные для обработки , сообщает allinsurance.kz .

Например, в России, по данным опроса «Лаборатории Касперского», чат-ботами пользовались 11% респондентов. При этом 30% опасаются, что из-за них значительное количество людей может лишиться работы. Другие исследования показали, что на помощь ChatGPT полностью полагаются 57% офисных работников в Бельгии, не проверяя при этом данные, и почти столько же (58%) респондентов в Великобритании видят потенциал инструментов ИИ для оптимизации рабочего времени. О том, что люди активно пользуются чат-ботом в повседневной жизни — и вероятно, для рабочих задач — говорят и данные о частоте поисковых запросов «ChatGPT». К примеру, в Казахстане количество поисковых запросов в сентябре 2023 года по сравнению с январем этого же года выросло более чем на 120%*.

На фоне растущей популярности ChatGPT возникает важный вопрос: можно ли ему доверять конфиденциальные данные? Исследователи «Лаборатории Касперского» выделили три основных риска при использовании чат-бота для бизнес-задач.

Утечка данных или взлом на стороне провайдера

Несмотря на то, что чат-боты на основе LLM (большие языковые модели) контролируются крупными технологическими компаниями, они не застрахованы от взлома или случайной утечки данных. В марте 2023 года произошёл сбой, из-за которого некоторые пользователи ChatGPT смогли видеть заголовки и первые сообщения в переписке других пользователей. Компании OpenAI пришлось из-за этого временно приостановить работу чат-бота.

Вредоносные подделки

Официальные сервисы вроде ChatGPT могут быть где-то заблокированы. В этом случае возникают серьёзные проблемы: пользователи могут скачать неофициальные альтернативы — программы, сайты, боты для мессенджеров — и случайно загрузить вредоносное ПО, замаскированное под клиент или приложение.

Взлом аккаунта

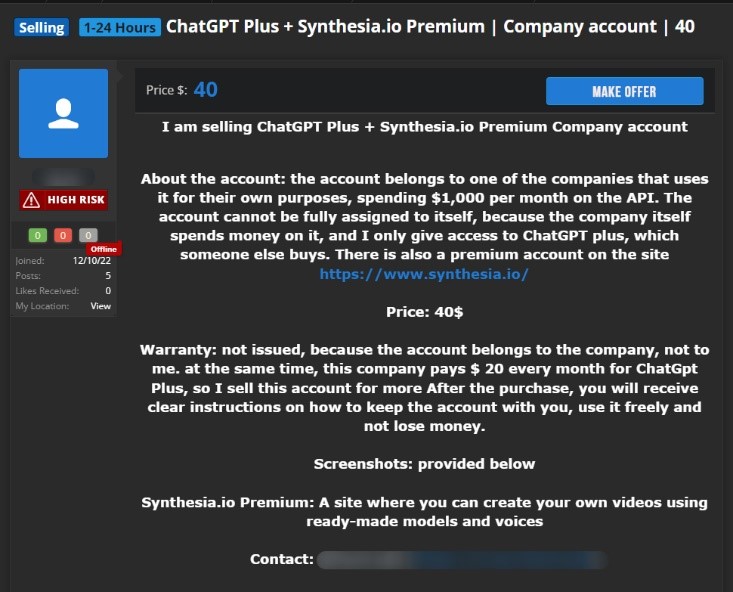

Злоумышленники могут получить доступ к аккаунтам сотрудников и их личным данным с помощью фишинга. Сервис Kaspersky Digital Footprint Intelligence регулярно обнаруживает на форумах в даркнете объявления о продаже доступа к аккаунтам в чат-ботах.

Пример объявления в даркнете, в котором предлагают получить доступ к корпоративному аккаунту в ChatGPT и Synthesia за $40

При этом с угрозой утечки данных при использовании чат-ботов могут столкнуться как обычные пользователи, так и компании. Поэтому ответственные разработчики подробно прописывают в политиках конфиденциальности, как именно данные используются для обучения модели.

Анализ «Лаборатории Касперского» популярных чат-ботов, в том числе ChatGPT, ChatGPT API, Anthropic Claude, Bing Chat, Bing Chat Enterprise, You.com, Google Bard и Genius App от Alloy Studios, показал, что в B2B-секторе, в котором более высокие стандарты безопасности и конфиденциальности, существуют и более серьёзные риски утечки конфиденциальной информации. Поэтому общие положения и условия использования, сбора, хранения и обработки данных больше ориентированы на его защиту, нежели на сектор B2C. Решения для B2B, описанные в этом исследовании, обычно автоматически не сохраняют историю чатов и в некоторых случаях на серверы компании не отправляется никаких данных, поскольку чат-бот работает локально в сети клиента.

«Изучив потенциальные риски использования чат-ботов на основе LMM для работы, мы пришли к выводу, что вероятность утечки конфиденциальных данных наиболее высока, когда сотрудники используют для работы свои личные аккаунты. Поэтому важно, чтобы компании рассказывали работникам о рисках, связанных с использованием чат-ботов. С одной стороны, сами сотрудники должны понимать, что такое личные и конфиденциальные данные, какие из них содержат коммерческую тайну, и почему их нельзя передавать чат-боту. С другой стороны, компания должна установить чёткие правила использования подобных сервисов, если ими вообще разрешено пользоваться», — комментирует Анна Ларкина, эксперт по контентному анализу «Лаборатории Касперского».

Чтобы обезопасить сотрудников и компании от рисков при использовании чат-ботов, эксперты «Лаборатории Касперского» рекомендуют:

- создавать сложные и уникальные пароли для каждой учётной записи, не использовать комбинации, которые легко угадать, например, дни рождения или имена;

- остерегаться фишинга: с осторожностью относиться к подозрительным электронным письмам, сообщениям или звонкам, в которых просят сообщить личные данные. Проверять подлинность отправителя, прежде чем передавать кому-то конфиденциальную информацию;

- обучать сотрудников кибербезопасности, чтобы они были в курсе актуальных онлайн-угроз и методов защиты. В этом может помочь образовательная платформа Kaspersky Automated Security Awareness Platform;

- регулярно обновлять программное обеспечение: операционную систему, приложения и антивирусные компоненты. Зачастую они содержат исправления в области безопасности;

- ограничить распространение корпоративной информации: передавать её только в случае крайней необходимости, с осторожностью обмениваться данными в соцсетях или на публичных форумах;

- внимательно проверять URL-адреса, особенно прежде чем ввести учётные данные или совершить покупку;

- установить защитное корпоративное решение, которое поможет предотвратить использование сотрудниками ненадёжных чат-ботов в рабочих целях, в том числе с функционалом аналитики облачных сервисов; например, в Kaspersky Endpoint Security Cloud есть инструмент Cloud Discovery для управления облачными сервисами, а также оценки рисков их использования.

*По данным Яндекс Wordstat

Источник allinsurance.kz