Исследователи в области инженерии из Университета штата Миннесота разработали передовое аппаратное устройство, которое может снизить потребление энергии в вычислительных программах искусственного интеллекта по меньшей мере в 1000 раз, сообщает psm7.com.

Фото: chatgpt.com

С ростом спроса на применение искусственного интеллекта исследователи ищут способы создать более энергоэффективный процесс, сохраняя при этом высокую производительность и низкие издержки. Обычно процессы машинного или искусственного интеллекта состоят из передачи данных между логикой (где информация обрабатывается в системе) и памятью (где хранятся данные), потребляя большое количество энергии и мощности.

Команда исследователей из Научно инженерного колледжа Университета Миннесоты продемонстрировала новую модель, в которой данные никогда не покидают память, под названием «вычислительная память с произвольным доступом» (CRAM).

"Эта работа является первой экспериментальной демонстрацией CRAM, где данные могут обрабатываться полностью в пределах массива памяти без необходимости покидать сетку, в которой компьютер хранит информацию", - сказал Янг Лв (Yang Lv), докторант кафедры электротехники и компьютерной инженерии Университета Миннесоты и первый автор статьи.

В марте 2024 года Международное энергетическое агентство (МЭА) опубликовало глобальный прогноз использования энергии, согласно которому потребление для ИИ, вероятно, удвоится с 460 терават-часов (ТВт-час) в 2022 году до 1000 ТВт-ч в 2026 году. Это примерно эквивалентно потреблению электроэнергии всей Японии.

По оценкам учёных, CRAM снизит энергопотребление в 1000 раз. При этом некоторые тесты демонстрируют экономию энергии в 2500 и 1700 раз по сравнению с традиционными методами.

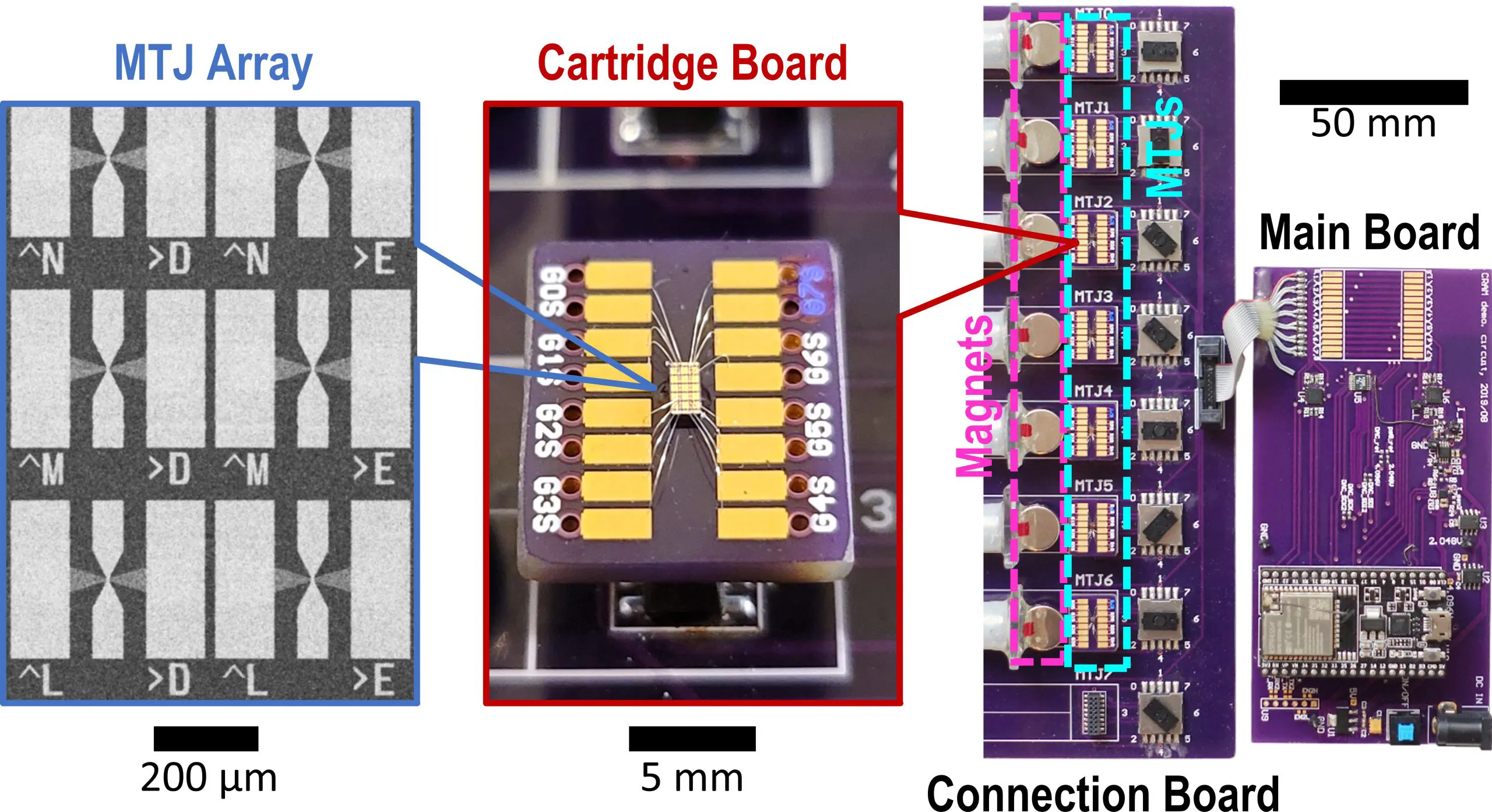

Специально разработанное аппаратное устройство поможет искусственному интеллекту быть более энергоэффективным. Фото: Университет Миннесоты

По словам ученых, это исследование длилось более двух десятилетий.

«Наша начальная концепция использования ячеек памяти непосредственно для вычислений 20 лет назад считалась безумной, – сказал Цзянь-Пин Ван, старший автор статьи. — С прогрессивной группой студентов действительно междисциплинарной командой преподавателей, созданной в Университете Миннесоты (от физики, материаловедения, компьютерных наук и инженерии, до моделирования и бенчмаркинга и создания аппаратного обеспечения) — мы смогли получить положительные результаты и теперь продемонстрировали, что такая технология осуществима и готова к внедрению в технику».

Это исследование является частью последовательных и длительных усилий, основанных на новаторских запатентованных исследованиях Цзянь-Пин Вана и его коллег в области магнитных туннельных переходов (MTJ) — наноструктурированных устройств, которые используются для усовершенствования жестких дисков, датчиков и других микроэлектронных систем, включая магнитную память с произвольным доступом (MRAM), используемый во встроенных системах, таких как микроконтроллеры и смарт-часы.

Как чрезвычайно энергоэффективная цифровая вычислительная основа в памяти, CRAM является очень гибкой в том смысле, что вычисления могут выполняться в любой ячейке массива памяти. Соответственно, мы можем изменять конфигурацию CRAM, чтобы лучше отвечать потребностям производительности различных алгоритмов искусственного интеллекта, — говорит Уля Карпузку (Ulya Karpuzcu), эксперт по архитектуре вычислений, соавтор статьи и доцент кафедры электротехники и компьютерной инженерии в Университете Миннесоты. — Он более энергоэффективный, чем традиционные строительные блоки для современных систем ИИ».

Пока команда планирует сотрудничать с лидерами полупроводниковой индустрии, в том числе в Миннесоте, для проведения масштабных демонстраций и производства аппаратного обеспечения, необходимого для развития функциональности искусственного интеллекта.

Исследование опубликовано в npj Unconventional Computing, рецензируемом научном журнале, издающемся Nature.

Автор Николай Деркач

Источник psm7.com